自己組織化マップは、最も人気のあるニューラルモデルの一つです。

これは、競合学習ネットワークのカテゴリに属します。SOMは、教師なし学習に基づいています。つまり、学習中に人間の介入は必要なく、入力データの特徴をほとんど知らなくてもよいのです。例えば、入力データのメンバーシップをクラスタリングするためにSOMを使用することができます。SOMは、問題に固有の特徴を検出することができるため、SOFM(Self Origination Feature Map)とも呼ばれています。

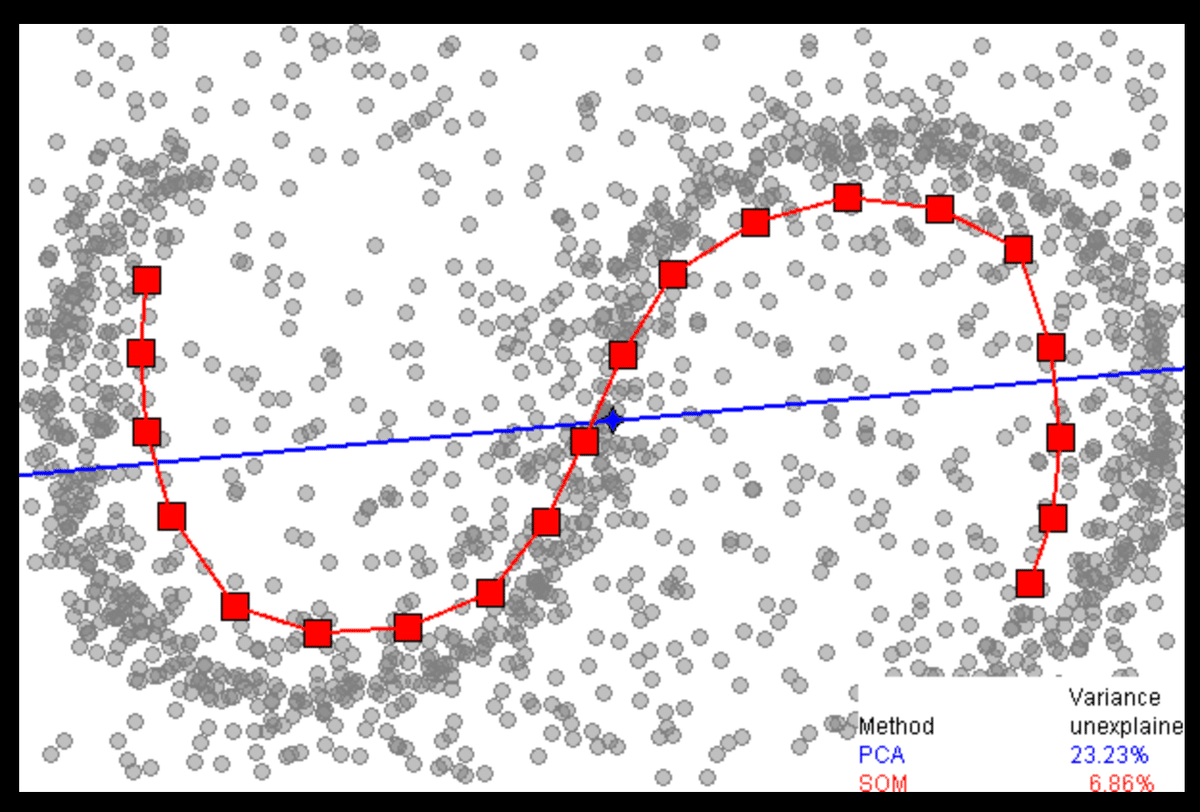

SOM は、主成分分析(PCA)の非線形一般化と考えられる

が、経験的直交関数(EOF)や PCA などの従来の特徴抽出手法に比べて多くの利点があることが、人工および実地球データを用いて示されている 。

SOMの解釈は2通りある。学習段階で近傍全体の重みが同じ方向に動かされるため、類似の項目は隣接するニューロンを興奮させる傾向がある。したがって、SOM は類似のサンプルは近くに、非類似のサンプルは離れてマッピングされるセマンティックマップを形成する。これは、SOMのU行列(隣接するセルの重みベクトル間のユークリッド距離)で可視化することができる。

もう一つの方法は、ニューロン重みを入力空間へのポインタと考えることである。これは、学習サンプルの分布の離散的な近似を形成する。そして,学習サンプルの集中する領域ではより多くのニューロンを指し示し,サンプルの少ない領域ではより少ないニューロンを指し示す.

U行列(統一距離行列)は、自己組織化マップ(SOM)の表現で、隣接するニューロンのコードブックベクトル間のユークリッド距離をグレースケール画像で描いたものである。この画像は、2次元画像を用いて高次元空間のデータを可視化するために使用される。

入力データを用いて SOM が学習されると、最終的なマップにはねじれが生じないことが期待される。マップにねじれがない場合、隣接するニューロンのコードブックベクトル間の距離は、基礎となるデータの異なる部分間の距離の近似値を与える。このような距離をグレースケール画像で表現すると、明るい色は間隔の狭いノードコードブックベクトルを表し、暗い色はより広く離れたノードコードブックベクトルを表します。したがって、明るい色の集まりをクラスタ、暗い部分をクラスタ間の境界と考えることができる。この表現により、高次元空間におけるクラスタの可視化や、比較的簡単な画像処理によるクラスタの自動認識などが可能になる。

主成分分析(PCA)の非線形一般化は、PCAが持つ線形の制限を超えて、データの非線形構造を捉えるための手法です。PCAは線形の次元削減手法であり、データの主要な方向を線形の軸として抽出します。しかし、多くの実世界のデータは非線形の関係性を持っているため、これらを適切に扱うためには非線形の手法が必要です。

PCAの非線形一般化に関しては、以下のような手法があります:

カーネル主成分分析(Kernel PCA):

カーネルPCAは、カーネルトリックを使用して非線形データの特徴を捉えます。

この手法では、データを高次元の特徴空間に射影し、その空間で線形のPCAを適用します。

結果として、元の非線形データの主要な構造を捉えることができます。

多次元尺度構成法(MDS):

MDSは、データポイント間の距離または類似性を保持しながら、高次元データを低次元に埋め込む手法です。

非線形MDSは、非線形の関係を考慮してデータを低次元に射影します。

t分布型確率的近傍埋め込み(t-SNE):

t-SNEは、高次元データのクラスタリングや可視化に広く使用される非線形次元削減手法です。

この手法は、高次元データポイント間の類似性を低次元空間に確率的に表現します。

自己組織化マップ(SOM):

SOMは、高次元データを低次元(通常2次元)の格子上に非線形に射影する手法です。

データのトポロジカルな構造を保持しながら、複雑なデータのパターンを可視化することができます。

これらの手法は、PCAの基本的な考え方を非線形データに拡張することで、より複雑なデータ構造を捉えることが可能になります。それぞれの手法は異なる特徴を持ち、特定の種類のデータや問題に適しています。