機械学習、特に強化学習において、グリッドワールドはエージェントが行動を学習するためのシンプルな環境としてよく使用されます。この環境は、様々な状態を持つ格子状の世界で構成され、エージェントは報酬を最大化するような行動を学習することが目的です。以下、グリッドワールドの基本的な構成要素としくみについて説明します。

グリッドワールドの構成要素

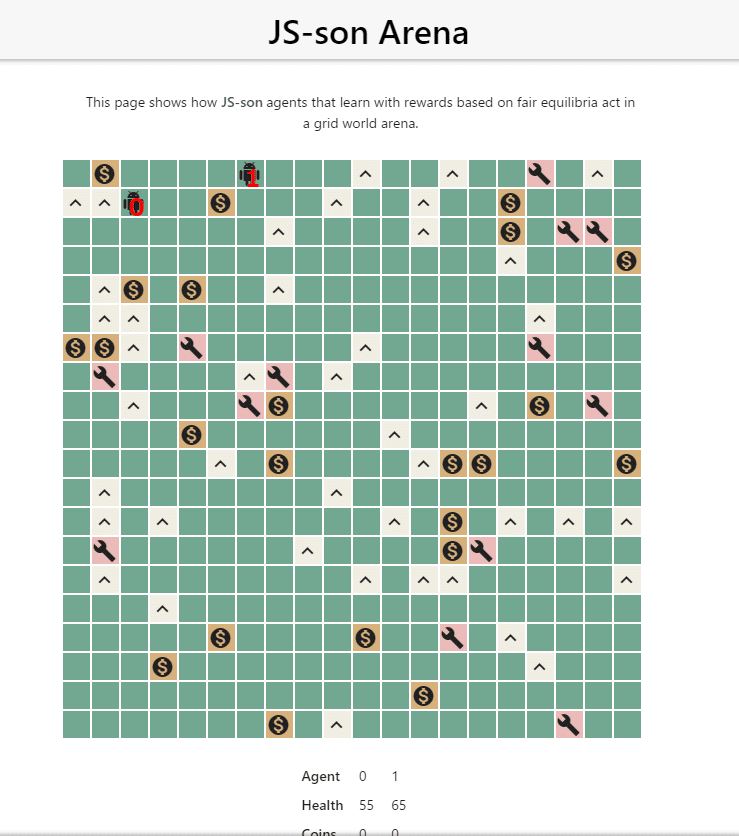

エージェント(Agent): 学習する主体であり、グリッドワールド内で行動します。

状態(State): グリッド内の各セルは異なる状態を表します。エージェントの現在位置は現在の状態を示します。

行動(Action): エージェントが取り得る行動(例: 上に移動、下に移動、左に移動、右に移動)。

報酬(Reward): 特定の行動を取った結果としてエージェントが受け取る報酬(またはペナルティ)。目標に到達すると正の報酬が、障害物にぶつかると負の報酬(またはペナルティ)が与えられることが一般的です。

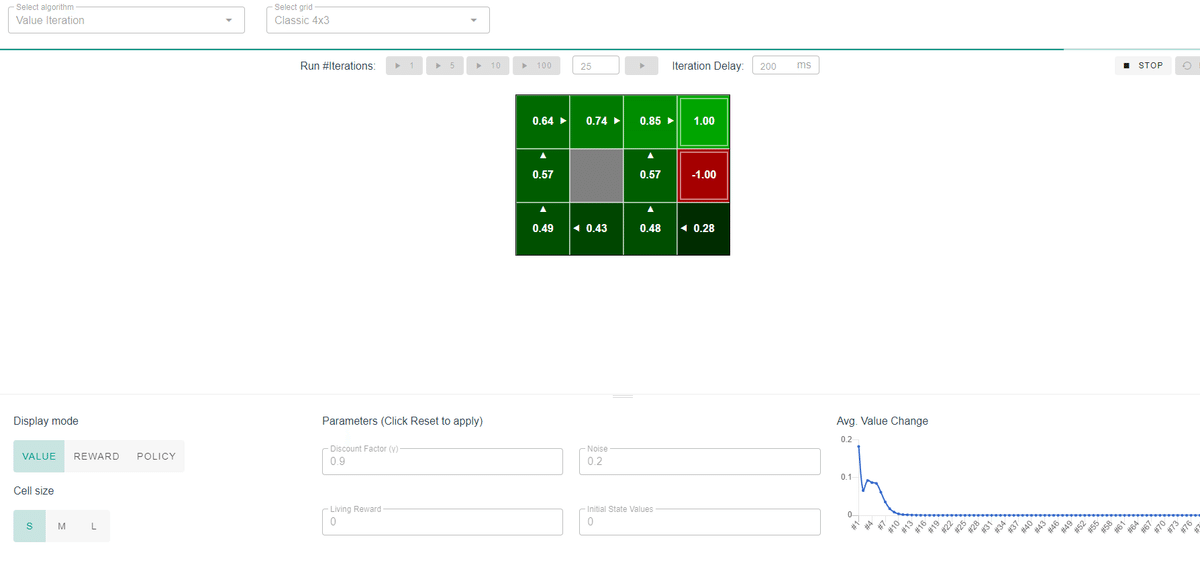

方針(Policy): 現在の状態からどの行動を選択するかを定義するエージェントの戦略です。

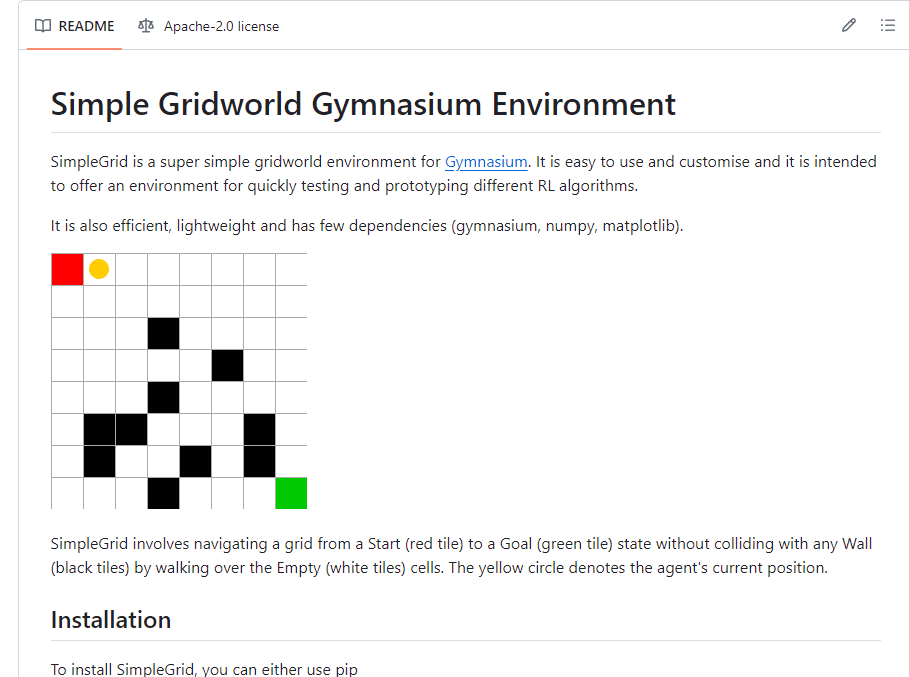

目標(Goal): エージェントが到達しようとする特定の状態。目標に到達することで、エージェントは報酬を得ます。

グリッドワールドのしくみ

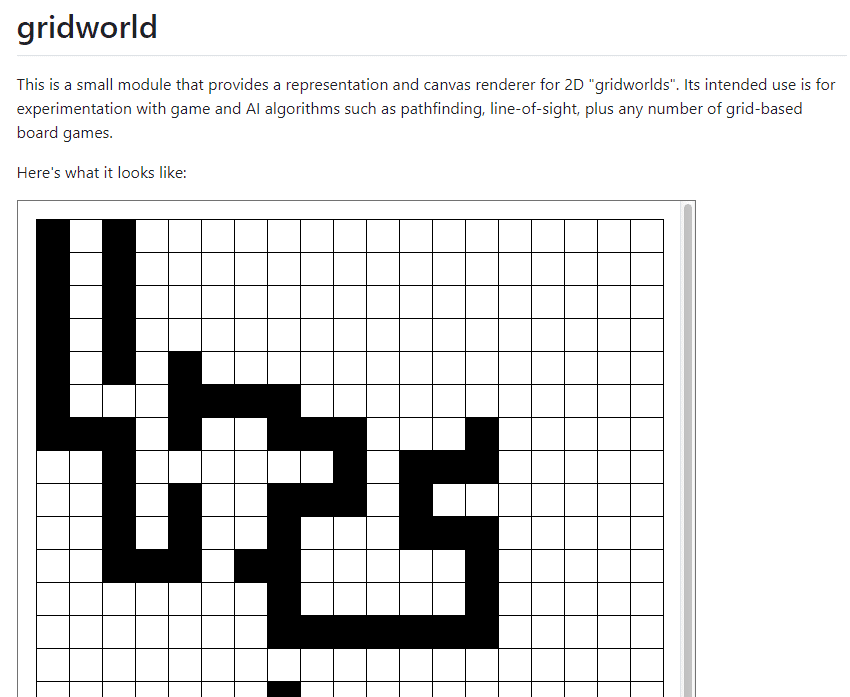

初期化: エージェントはグリッドのスタート位置に配置されます。グリッドのサイズ、目標の位置、障害物の位置などが設定されます。

エピソード: エージェントはスタート位置から始めて、目標位置に到達するか、あるいは終了条件を満たすまで行動を繰り返します。各ステップでエージェントは状態を観察し、方針に従って行動を選択し、行動の結果として環境から報酬を受け取ります。

学習: エージェントは経験を通じて、報酬を最大化するための方針を改善します。これは、Q学習、SARSA、深層Qネットワーク(DQN)などの強化学習アルゴリズムを使用して行われます。

評価: 学習が進むにつれて、エージェントはより効果的に目標に到達することができるようになります。エージェントの性能は、エピソードを通じて獲得した総報酬で評価されます。

グリッドワールドは、エージェントが直面する決定問題を抽象化し、強化学習アルゴリズムの基本原理を理解するための簡単なモデルを提供します。実際の応用では、より複雑な環境やアルゴリズムが用いられますが、グリッドワールドは強化学習の概念を学ぶのに非常に役立つ入門例です。